Attribuer l'invention de l'IA à une seule personne est l'erreur de lecture la plus répandue sur ce sujet. Cette discipline est le produit d'une convergence entre logique formelle, neurobiologie computationnelle et mathématiques, construite collectivement sur plusieurs décennies.

L'essor initial de l'intelligence artificielle

Les années 1950-1960 ne sont pas une période d'exploration tâtonnante. Ce sont deux décennies de fondations conceptuelles et techniques posées à un rythme soutenu.

Les prémices des années 1950

Six ans séparent deux ruptures intellectuelles majeures, et cette cadence n'est pas anodine.

En 1950, Alan Turing publie sa question fondatrice : une machine peut-elle penser ? Le test qu'il propose n'est pas un gadget philosophique. C'est un protocole d'évaluation opérationnel — une machine réussit si un observateur humain ne distingue plus sa réponse de celle d'un humain. Ce cadre conceptuel déplace le débat de la métaphysique vers la mesure.

Six ans plus tard, la conférence de Dartmouth transforme cette intuition en discipline. Pour la première fois, des chercheurs se réunissent autour d'un postulat commun : l'intelligence humaine peut être décrite avec suffisamment de précision pour qu'une machine la simule.

| Événement | Description |

|---|---|

| 1950 | Alan Turing propose le test de Turing comme critère d'évaluation de l'intelligence machine. |

| 1952 | Arthur Samuel développe un programme d'apprentissage aux dames, première démonstration d'apprentissage automatique. |

| 1956 | La conférence de Dartmouth officialise l'IA comme champ de recherche autonome. |

| 1958 | Frank Rosenblatt conçoit le Perceptron, premier modèle formel de réseau de neurones artificiels. |

La décennie ne produit pas encore de systèmes performants. Elle produit quelque chose de plus durable : un vocabulaire commun et une ambition partagée.

Les innovations des années 1960

Les années 1960 marquent le passage de la théorie à la machine. L'IA cesse d'être un concept de laboratoire pour devenir un objet physique et interactif.

Deux ruptures structurent cette décennie :

- En 1961, l'Unimate entre en service dans une usine General Motors. Ce premier robot industriel démontre qu'un algorithme peut piloter une action physique répétable — la boucle programme/effecteur devient un modèle industriel durable.

- En 1965, Joseph Weizenbaum développe ELIZA, programme pionnier du traitement du langage naturel. ELIZA simule un interlocuteur en analysant des patterns textuels. Ce mécanisme révèle une limite structurelle : la machine produit une réponse cohérente sans comprendre le sens — distinction qui alimente encore aujourd'hui les débats sur l'intelligence artificielle générale.

Ces deux jalons posent les deux axes fondateurs de l'IA appliquée : agir sur le monde physique, interagir avec le langage humain.

Du test de Turing au robot industriel, la trajectoire est nette : l'IA passe du postulat à l'action. La décennie suivante va confronter cette ambition à ses premières limites structurelles.

Les pionniers incontournables de l'IA

Trois noms structurent l'histoire intellectuelle de l'IA : Turing pose les questions, McCarthy nomme le champ, Minsky bâtit l'institution.

Alan Turing et ses contributions

Deux contributions de Turing ont redéfini le cadre intellectuel de l'informatique. La première : le concept de machine universelle, un automate théorique capable d'exécuter n'importe quel algorithme calculable. Ce modèle abstrait, formulé dans les années 1930, constitue le socle logique sur lequel reposent tous les ordinateurs modernes.

La seconde contribution est plus provocatrice. Le test de Turing, proposé en 1950, pose une question précise : peut-on distinguer, par écrit, une machine d'un être humain ? Si la réponse est non, la machine est considérée comme « intelligente ». Ce protocole a structuré des décennies de débat sur ce que signifie réellement l'intelligence artificielle.

L'apport de Turing ne se mesure pas à ses inventions techniques, mais à sa capacité à formuler les bonnes questions. Définir ce qu'une machine peut faire, puis ce qu'elle semble faire — cette distinction reste au cœur de l'IA contemporaine.

L'impact de John McCarthy

En 1956, John McCarthy forge le terme intelligence artificielle lors de la conférence de Dartmouth. Ce n'est pas un acte de communication : c'est un acte fondateur qui délimite un champ scientifique entier et lui donne une légitimité institutionnelle.

Son second apport change la pratique concrète des chercheurs. Le langage LISP, qu'il développe à la fin des années 1950, offre aux programmeurs un outil capable de manipuler des symboles plutôt que de simples nombres. Cette distinction est décisive : la manipulation symbolique est précisément ce dont les premiers systèmes d'IA ont besoin pour raisonner, comparer et déduire.

McCarthy ne se contente pas de nommer une discipline. Il lui fournit simultanément un vocabulaire conceptuel et un instrument technique. Ces deux contributions forment un socle sur lequel des décennies de recherche en IA se sont construites.

Marvin Minsky et le MIT

Cofondateur du laboratoire d'intelligence artificielle du MIT en 1959, Marvin Minsky a structuré un cadre institutionnel qui allait orienter plusieurs décennies de recherche. Ce n'est pas un détail : ancrer l'IA dans une institution comme le MIT lui a conféré une légitimité académique durable, attirant financements et talents sur le long terme.

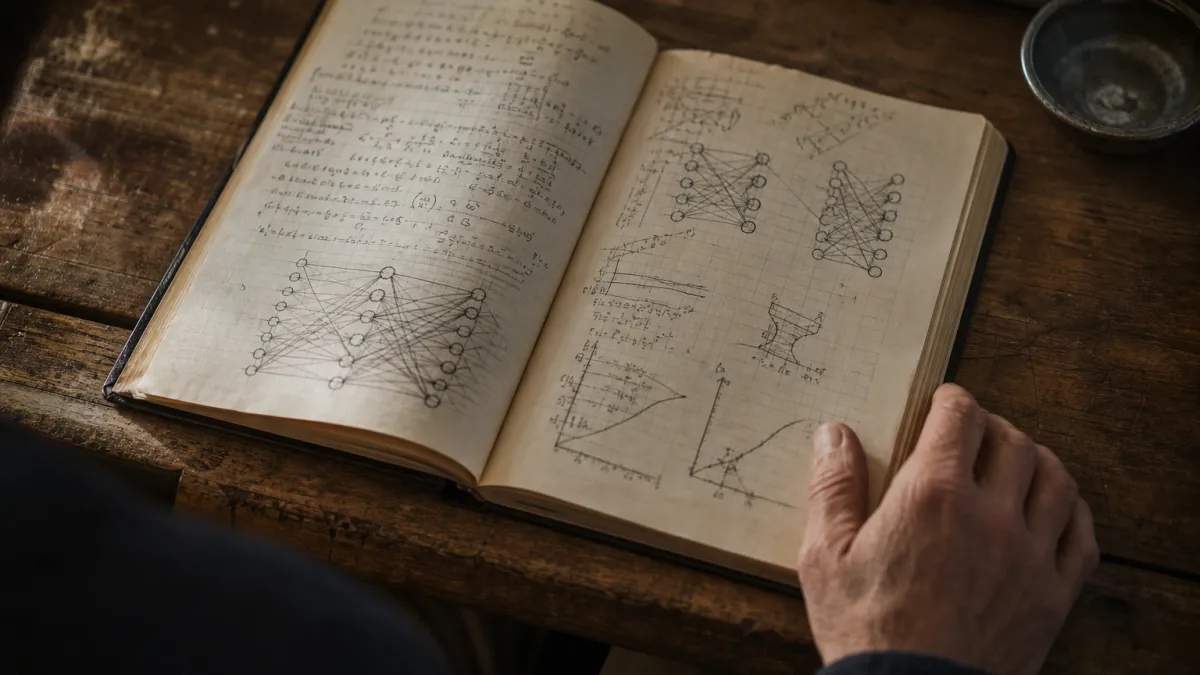

Ses travaux portent sur deux axes distincts. Les réseaux neuronaux, d'abord, qu'il a analysés comme des systèmes de traitement distribué avant que le domaine ne connaisse son essor actuel. La théorie de la société de l'esprit, ensuite : un modèle selon lequel l'intelligence émerge de l'interaction entre de nombreux agents simples, sans qu'aucun ne soit porteur de sens à lui seul.

Ce mécanisme reste une référence conceptuelle pour comprendre pourquoi les systèmes d'IA modernes reposent sur des architectures massivement parallèles plutôt que sur une logique centralisée.

Ces trois trajectoires convergent vers un même constat : l'IA n'a pas émergé d'une intuition isolée, mais d'un cadre théorique, conceptuel et institutionnel construit méthodiquement.

Comprendre les origines de l'IA, c'est lire la carte des décisions qui structurent les systèmes actuels.

Chaque avancée de 2026 porte la trace d'un choix théorique fait entre 1950 et 1980. Tracez cette généalogie pour évaluer les limites réelles des outils que vous utilisez.

Questions fréquentes

Qui est considéré comme l'inventeur de l'intelligence artificielle ?

John McCarthy est reconnu comme le père fondateur de l'IA. En 1956, il forge le terme « intelligence artificielle » lors de la conférence de Dartmouth, qu'il organise avec Marvin Minsky, Nathaniel Rochester et Claude Shannon.

Quand l'intelligence artificielle a-t-elle été inventée ?

L'année 1956 marque la naissance officielle de la discipline. La conférence de Dartmouth College pose les bases théoriques et programmatiques. Toutefois, les travaux d'Alan Turing dès 1950 constituent le socle conceptuel indispensable à cette fondation.

Quel rôle Alan Turing a-t-il joué dans la création de l'IA ?

Turing pose la question centrale en 1950 : « Les machines peuvent-elles penser ? » Son test de Turing fournit le premier cadre d'évaluation d'une intelligence machine. Sans lui, la conférence de Dartmouth n'aurait pas eu de fondement théorique solide.

Quels sont les autres pionniers majeurs de l'intelligence artificielle ?

Marvin Minsky, cofondateur du MIT AI Lab, et Claude Shannon, père de la théorie de l'information, structurent la discipline. Herbert Simon et Allen Newell créent dès 1956 le premier programme de raisonnement automatique : le Logic Theorist.

Quelle différence entre l'IA symbolique des origines et l'IA actuelle ?

L'IA des années 1950-1980 repose sur des règles logiques explicites codées par des humains. L'IA contemporaine s'appuie sur l'apprentissage automatique : les systèmes extraient eux-mêmes des règles à partir de volumes massifs de données.